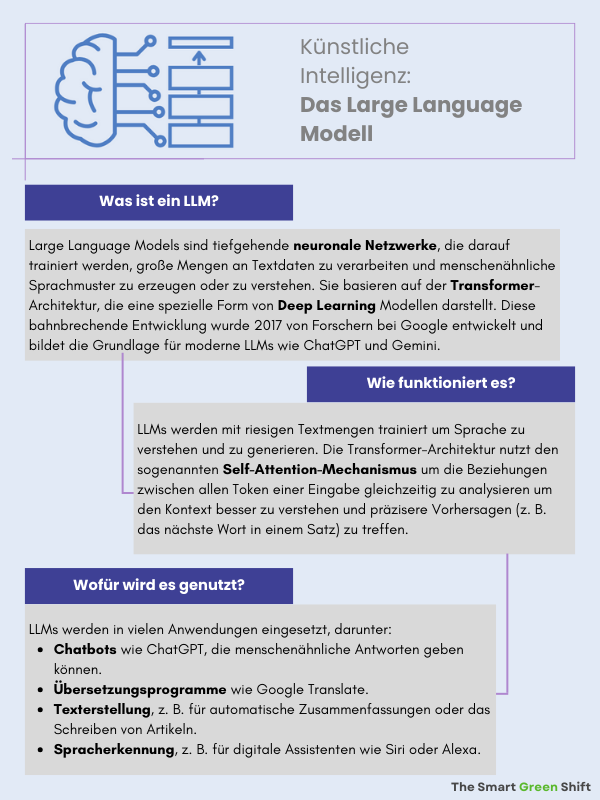

Künstliche Intelligenz (KI) hat sich in den letzten Jahren rasant entwickelt und ist heute in nahezu allen Bereichen des Lebens präsent. Sprachassistenten, personalisierte Produktempfehlungen, autonome Fahrzeuge oder die medizinische Diagnostik sind nur einige der vielfältigen Anwendungsfelder, in denen KI enorme Fortschritte und bahnbrechende Entwicklungen ermöglicht. Auch in Bezug auf Nachhaltigkeit wird ihr großes Potenzial gepriesen: Durch optimierte Prozesse lassen sich Ressourcen effizienter nutzen, Erträge in der Landwirtschaft steigern und Energieverbräuche in intelligenten Stromnetzen anpassen (mehr dazu hier). Große Sprachmodelle, sogenannte LLMs (Large Language Models), wie ChatGPT oder Googles Gemini, eröffnen völlig neue Möglichkeiten für die Forschung, Wirtschaft und Gesellschaft. Doch während die technologischen Innovationen gefeiert werden, rücken auch ihre ökologischen Auswirkungen zunehmend in den Fokus.

Künstliche Intelligenz klingt zunächst wie ein abstraktes, immaterielles Konzept, aber sie basiert auf einer sehr realen, physischen Infrastruktur, die sowohl Fortschritt und Chancen als auch Herausforderungen mit sich bringt. Insbesondere die großen Transformer-Modelle stehen im Zentrum der Diskussion um Nachhaltigkeit und Ressourcenverbrauch. Während KI bereits seit längerer Zeit in verschiedenen Formen existiert, haben leistungsstarke LLMs erst in jüngerer Zeit an Bedeutung gewonnen. Seit der Veröffentlichung von Modellen wie BERT, GPT und T5 ab 2017 ist der Ressourcenverbrauchdieser Technologien auch in den Fokus wissenschaftlicher Untersuchungen gerückt. Studien wie Energy and Policy Considerations for Deep Learning in NLP (Strubell et al., 2019) sowie neuere Arbeiten von Google und OpenAI haben erste belastbare Zahlen zum Energiebedarf und CO₂-Fußabdruck geliefert. Dennoch bleiben viele Aspekte bislang unklar, insbesondere wenn es um den gesamten Lebenszyklus der Systeme geht – von der Hardwareproduktion über das Training und die Anwendung bis hin zur Wartung.

Zwar sind viele Zahlen und Berechnungen mangels Transparenz und valider Daten noch nicht gänzlich aussagekräftig, doch die Dimensionen des Ressourcenverbrauchs werden bereits deutlich. Das Ziel dieses Artikels ist es, einen annäherungsweisen Überblick über den ökologischen Fußabdruck moderner KI-Modelle zu vermitteln.

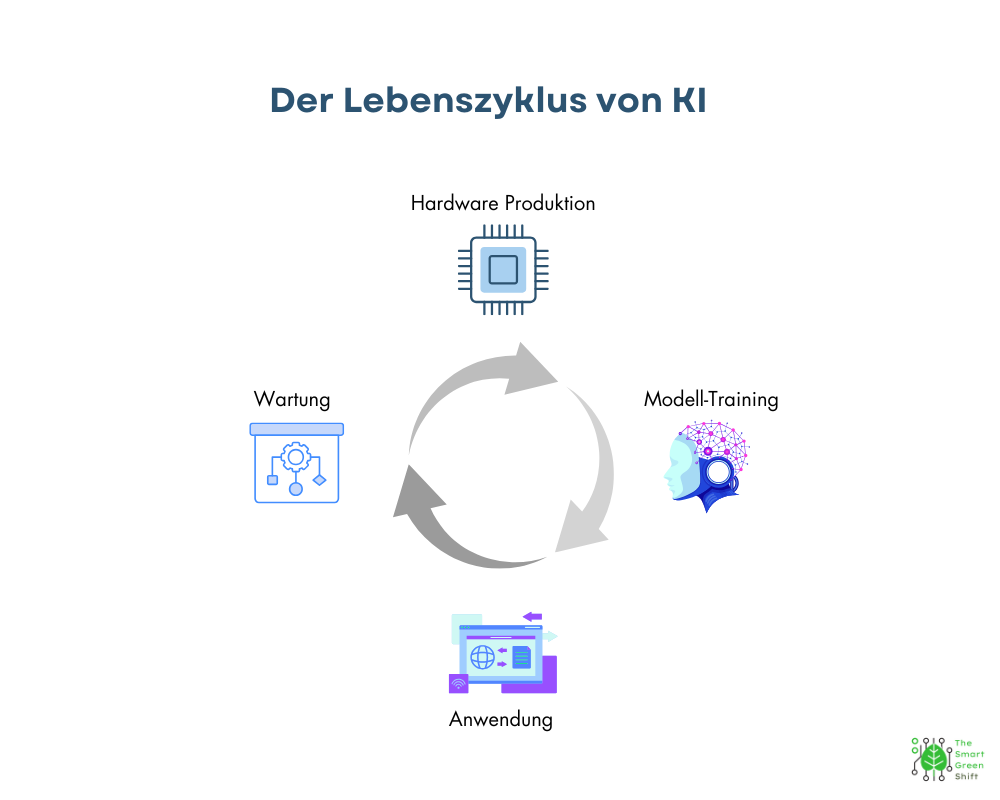

Ressourcenverbrauch im Lebenszyklus von Künstlicher Intelligenz

Der Ressourcenverbrauch von KI lässt sich in vier zentrale Phasen unterteilen. Die erste Phase betrifft die für die physische Infrastruktur benötigte Hardwareproduktion, die Mengen an Energie und Rohstoffen verschlingt – insbesondere bei der Herstellung spezialisierter Chips und dem Bau von Rechenzentren. In der zweiten Phase, dem Training, werden gigantische Datenmengen verarbeitet, was einen hohen Strom- und Wasserverbrauch verursacht. Die dritte Phase umfasst die Anwendung der KI, also die Interaktion mit Nutzern, wobei jede Anfrage an ein Modell wie ChatGPT weiterhin Energie und Wasser benötigt. Schließlich erfordert auch die Wartung dieser Systeme kontinuierliche Rechenleistung und Infrastruktur, wodurch der Ressourcenverbrauch dauerhaft hoch bleibt.

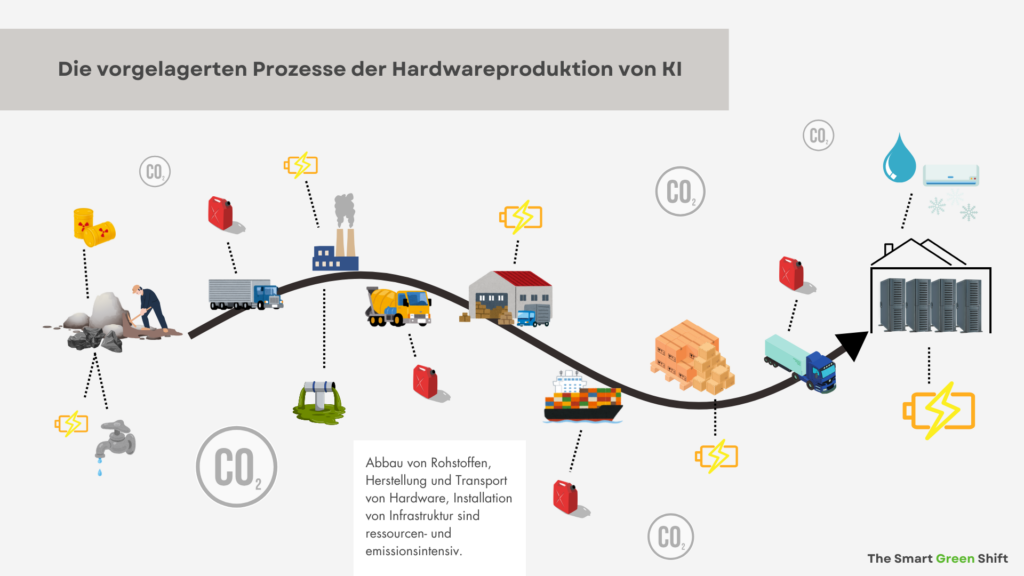

Hardwareproduktion: Hoher Rohstoffaufwand für die Fertigung komplexer Systeme

Die physische Infrastruktur moderner KI-Anwendungen bildet Hardware, die speziell für rechenintensive Aufgaben entwickelt wird. Die Produktion von KI-Beschleunigern (AI Accelerators) und anderen spezialisierten KI-Hochleistungsprozessoren ist ein energieintensiver und ressourcenverbrauchender Prozess. Die Halbleiterfertigung erfordert hochreine Materialien und komplexe chemische Prozesse. Dabei werden nicht nur seltene Metalle wie Kupfer, Tantal und Seltene Erden benötigt, sondern auch große Mengen an Energie und Wasser, die beim Abbau und der Aufbereitung der Materialien zum Einsatz kommen. Der Abbau der Rohstoffe findet häufig in Regionen statt, in denen es an strengen Umwelt- und Sozialstandards mangelt. Die dadurch verseuchten Böden und das vergiftete Grundwasser haben negative Auswirkungen auf Ökosysteme, und die Menschen leiden an gesundheitlichen Folgen.

In Reinräumen werden die Bauteile anschließend unter streng kontrollierten Bedingungen gefertigt, was den Energiebedarf weiter in die Höhe treibt. Zudem sind die Produktionsprozesse von Halbleitern oft mit einem hohen Anteil an Schadstoffen verbunden, wie beispielsweise Chemikalien, die in der Ätzung und im Aufbringen von dünnen Schichten verwendet werden.

Ein Rechenzentrum besteht nicht nur aus Servern, sondern auch aus komplexen Klimatisierungs- und Energieversorgungssystemen. Die Herstellung dieser Komponenten ist ebenfalls ressourcenintensiv. Der gesamte Produktionszyklus ist zudem von einer langen Lieferkette abhängig, die sowohl den Transport als auch die Lagerung von Rohstoffen und Fertigprodukten umfasst. Diese Logistikkette ist häufig global organisiert, was den CO₂-Fußabdruck zusätzlich vergrößert.

Ein Großteil des Ressourcenverbrauchs von KI entfällt also auf die vorgelagerten Prozesse wie Herstellung, Transport und Installation der notwendigen Infrastruktur. All diese Faktoren tragen dazu bei, dass die Hardwareproduktion für KI-Anwendungen zu den ökologisch belastendsten Phasen im Lebenszyklus zählt.

Die anschließenden Phasen von Training und Anwendung finden meist in jeweils unterschiedlichen Rechenzentren oder auf unterschiedlicher Hardware statt. Der Grund dafür liegt in den unterschiedlichen Anforderungen beider Prozesse. Dies erhöht den Ressourcenverbrauch zusätzlich.

Das Training der Modelle

Ist die physische Infrastruktur bzw. die Hardware hergestellt und einsatzbereit, beginnt die Phase des Trainings. Das Training großer Sprachmodelle ist besonders energieintensiv. Um die komplexen Zusammenhänge menschlicher Sprache zu erlernen, werden neuronale Netze mit Milliarden von Parametern über Tage, Wochen oder gar Monate auf spezialisierten Rechenclustern trainiert. Dieser Prozess erfordert den Einsatz großer Mengen an Strom. Moderne Rechenzentren, die für solche Trainingsläufe genutzt werden, arbeiten oft rund um die Uhr, wobei nicht nur für den Betrieb der Hardware, sondern auch für die Kühlung der Geräte enorme Mengen an Energie und Wasser anfallen. Die Kühlung ist notwendig, um die Wärme, die durch die intensive Rechenleistung entsteht, abzuführen und den Betrieb stabil zu halten. Dies führt zu einem zusätzlichen Ressourcenbedarf, der den ökologischen Fußabdruck weiter erhöht.

Eine Studie der US-amerikanischen Zeitung Washington Post in Zusammenarbeit mit der University of California in Riverside hat sich mit dem Ressourcenverbrauch beim Training von KI befasst und errechnet, dass für das Training von OpenAIs GPT-3 in den Rechenzentren von Microsoft 700.000 Liter Wasser für Kühlzwecke benötigt wurden. Einen weitaus höheren Verbrauch hatte Metas Sprachmodell Llama-3, für dessen Training 22 Millionen Liter genutzt worden sein sollen.

Ein zentraler Faktor für den hohen Energieverbrauch liegt in der Anzahl der Berechnungen, die während des Trainings durchgeführt werden müssen. Jedes Gewicht in einem neuronalen Netzwerk wird in vielen Iterationen angepasst, was zu einer exponentiellen Steigerung der Rechenoperationen führt. Es ist die Kombination aus hoher Rechenintensität und langen Trainingszeiten, die beim Training von KI-Modellen zu einem derart hohen Verbrauch an Strom und Wasser führen.

Anwendung: KI im Betrieb

Wurde das KI-Modell erfolgreich trainiert, ist es bereit für den Einsatz. Diese Phase der Anwendung wird Inferenz-Phase genannt: Das Modell reagiert auf Eingaben und generiert Ergebnisse. Dies erfordert ständige Berechnungen in Echtzeit. Ressourcentechnisch wird für die Inferenz Energie – also Strom – benötigt sowie wiederum Strom und Wasser für die Kühlung der Server.

Auf den ersten Blick scheint die Inferenz der Teil im Lebenszyklus der KI zu sein, bei dem der Ressourcenverbrauch am geringsten ist, doch dieser Eindruck täuscht. Zwar ist der Energieverbrauch pro einzelner Anfrage an ein Sprachmodell gering, doch es ist die wachsende Flut an Anfragen, die den Energie- und Wasserverbrauch in die Höhe schnellen lässt. Die folgenden Beispiele verdeutlichen dies: Das US-amerikanische Electric Power Research Institute (EPRI) hat berechnet, dass eine einzelne Anfrage an ChatGPT einen Stromverbrauch von 0,0029 Kilowattstunden hat. Das entspricht dem Zehnfachen des Energiebedarfs einer herkömmlichen Google-Suche, die bei etwa 0,0003 kWh liegt. Diese Zahl von 0,0029 kWh klingt relativ harmlos und isoliert betrachtet ist sie das auch. Richtig eindrucksvoll wird es aber bei der Skalierung: Die Trading-Website BestBrokers hat dazu – basierend auf den Angaben von OpenAI und den Ergebnissen zum Verbrauch vom EPRI – folgende Berechnung angestellt: An einem Tag werden circa 1 Milliarde Anfragen an ChatGPT gestellt, was einen Stromverbrauch von 2,9 Millionen kWh pro Tag ergibt. Auf das Jahr gesehen – bei gleichbleibender Anzahl der Nutzer und Anfragen wohlgemerkt – wären das über 1 Milliarde kWh bzw. 1 TWh (Terawattstunde). Zum Vergleich: Ein durchschnittlicher US-Haushalt verbraucht laut der amerikanischen Energy Information Administration (EIA) täglich um die 29 kWh. ChatGPT verbraucht demnach 100.000-mal mehr Energie als ein durchschnittlicher Haushalt. In der Realität dürfte der Verbrauch jedoch weit höher ausfallen, wenn man sich den jährlichen Zuwachs aktiver Nutzer anschaut. OpenAI hat kürzlich bekannt gegeben, dass sein Chatbot ChatGPT 300 Millionen aktive Nutzer pro Woche erreicht hat. Das seien doppelt so viele wie im September 2023. Auch ständig hinzukommende neue Features wie Audio-, Video- und Bild-Erstellung dürften die Anzahl der Nutzer beträchtlich wachsen lassen.

Auch die bereits erwähnte Studie der Washington Post und der University of California befasst sich mit dem Ressourcenverbrauch von KI-Systemen während der Inferenz. Dazu haben sie den Energie- und Wasserverbrauch untersucht. Ihre Untersuchungen ergaben, dass das Erstellen einer einfachen E-Mail von 100 Wörtern mit ChatGPT 0,14 kWh und einen halben Liter Wasser zur Kühlung der Infrastruktur verbraucht. Auf ein Jahr hochgerechnet wären dies bei einer E-Mail pro Woche 7,5 kWh und 27 Liter Wasser. Auch hier wird es erst richtig eindrücklich, wenn diese Zahlen hochgerechnet werden: Wenn 10 % der US-Erwerbstätigen pro Woche eine E-Mail mit 100 Wörtern mit ChatGPT erstellen, entspräche der Energiebedarf laut Washington Post dem gesamten Stromverbrauch aller Haushalte in Washington D.C. über 20 Tage sowie dem Wasserverbrauch von 435 Millionen Litern, was dem Verbrauch aller Haushalte im Bundesstaat Rhode Island für anderthalb Jahre entspricht.

Selbst diese konservativ gerechneten Zahlen reichen bereits, um einen Eindruck von den Dimensionen zu erlangen, die beim Ressourcenverbrauch während der Inferenz entstehen.

Seit 2020 ist der Stromverbrauch von Rechenzentren kontinuierlich gestiegen. Ein wesentlicher Treiber dieser Entwicklung ist die zunehmende Nutzung künstlicher Intelligenz (KI). Goldman Sachs Research schätzt, dass der Strombedarf von Rechenzentren bis 2030 um 160 % steigen wird. Derzeit entfallen auf Rechenzentren, für sämtliche IT-Workloads, inklusive KI, weltweit 1–2 % des gesamten Stroms, aber dieser Prozentsatz wird bis zum Ende des Jahrzehnts wahrscheinlich, bedingt durch den Anstieg der Entwicklung und Nutzung von KI, auf 3–4 % steigen. Bis 2028 könnte KI demnach etwa 19 % des Strombedarfs von Rechenzentren ausmachen. In den USA beispielsweise lag der Anteil von Rechenzentren am gesamten Stromverbrauch im Jahr 2022 bei 3 %, dieser Wert könnte durch den Anstieg von KI bis 2030 auf 8 % steigen, was beinahe einer Verdreifachung entspräche. Goldman Sachs Research schätzt, dass der Gesamtanstieg des Stromverbrauchs von Rechenzentren durch KI zwischen 2023 und 2030 bei etwa 200 Terawattstunden pro Jahr liegen wird. Im Zuge dieser Entwicklungen könnten sich die Kohlendioxidemissionen von Rechenzentren zwischen 2022 und 2030 mehr als verdoppeln.

Wartung der Systeme

Nach der Inbetriebnahme eines KI-Systems beginnt die Phase der Wartung und kontinuierlichen Optimierung. Dies umfasst die regelmäßige Aktualisierung von Software und Hardware, um Sicherheitslücken zu schließen, neue Funktionen zu integrieren, die Leistung zu optimieren und verschlissene Hardware zu ersetzen. Wartung ist ein oft unterschätzter, aber wesentlicher Aspekt des Lebenszyklus von KI-Systemen, der ebenfalls einen erheblichen Einfluss auf den ökologischen Fußabdruck hat.

Die kontinuierliche Wartung beinhaltet auch das Monitoring der Systeme, um Ausfälle zu verhindern und eine konstante Betriebsbereitschaft zu gewährleisten. Dies erfolgt häufig über zusätzliche Rechenressourcen, die in den Rechenzentren betrieben werden. Auch wenn der Energieverbrauch einzelner Wartungsvorgänge relativ gering sein mag, so addiert er sich doch über die Lebensdauer eines KI-Systems zu einem beachtlichen Verbrauch. Zudem führt der Austausch von veralteter Hardware zu zusätzlichen Ressourcenaufwendungen. Neue Generationen von Prozessoren und Speicherkomponenten werden benötigt, um den steigenden Anforderungen gerecht zu werden, was wiederum zu neuen Produktionszyklen führt, die den ökologischen Fußabdruck weiter vergrößern.

Ein weiterer wichtiger Punkt in der Wartungsphase ist die Aktualisierung der zugrunde liegenden Algorithmen. Fortschritte in der Forschung führen oft zu neuen, effizienteren Methoden, die jedoch häufig eine erneute Phase des Trainings und der Integration in bestehende Systeme erfordern, bevor sie ihre Effizienz entfalten können. Die Komplexität moderner KI-Systeme macht es nahezu unvermeidlich, dass Wartungsarbeiten in regelmäßigen Abständen zu zusätzlichen Lasten in der Energie- und Ressourcenbilanz führen.

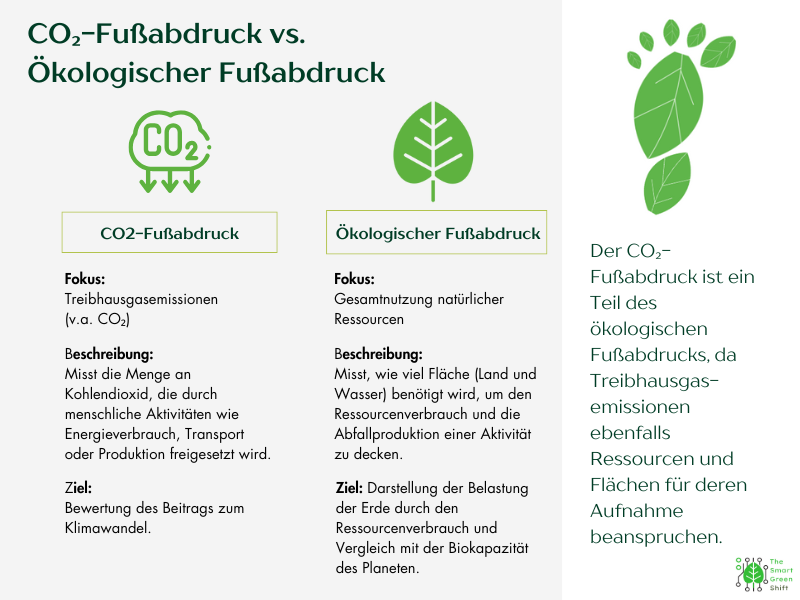

Herausforderung bei der Berechnung des ökologischen Fußabdrucks

Der ökologische Fußabdruck und die CO₂-Bilanz des gesamten Lebenszyklus von KI-Modellen, insbesondere von Transformer-Modellen, lassen sich derzeit nicht präzise berechnen. Dies liegt vor allem an lückenhaften Informationen über den tatsächlichen Ressourcenverbrauch. Während für bestimmte Phasen, wie die Inferenz, mittlerweile vereinzelt Zahlen zum Energieverbrauch vorliegen, bleibt insbesondere die ressourcenintensive Hardwareproduktion weitgehend intransparent.

Zusätzlich erschweren mehrere Faktoren die genaue Messung: Erstens sind die Energieverbräuche von KI-Trainingsprozessen oft nicht nachvollziehbar, da Rechenzentren unterschiedliche Energiequellen nutzen und Unternehmen selten detaillierte Verbrauchsdaten offenlegen. Zweitens variiert der Energiebedarf erheblich in Abhängigkeit von Hardware, Modellgröße und Trainingsdauer. Drittens entstehen Emissionen nicht nur durch den direkten Stromverbrauch, sondern auch durch Herstellung und Entsorgung der Hardware, für die es in vielen Teilen der Welt keine Berichtspflicht zur Nachhaltigkeit gibt. Zudem fehlen standardisierte Methoden, um den tatsächlichen Fußabdruck konsistent zu bewerten.

Im Rahmen des Green Deal nimmt die Europäische Union Betreiber von Rechenzentren deshalb seit kurzem stärker in die Verantwortung, indem sie durch Berichtspflichten mehr Transparenz über den Energie- und Ressourcenverbrauch sowie die entstehenden Emissionen schafft. Die EU-Energieeffizienzrichtlinie (EU) 2023/1791 verpflichtet Eigentümer und Betreiber von Rechenzentren mit einem Strombedarf der installierten Informationstechnologie von mindestens 500 kW, verschiedene Informationen mit Nachhaltigkeitsbezug zu veröffentlichen. Diese Berichtspflichten wurden durch die delegierte Verordnung C/2024/1639 vom 14. März 2024 weiter konkretisiert. Die Betreiber müssen nun bestimmte Daten an eine von der Europäischen Kommission bereitgestellte Datenbank melden. Zusätzlich trat am 1. Januar 2024 die Corporate Sustainability Reporting Directive (CSRD) in Kraft, die Unternehmen verpflichtet, Informationen über klimabezogene Risiken und gesellschaftliche Auswirkungen offenzulegen. Diese Richtlinie ist ebenfalls Teil des European Green Deal und zielt darauf ab, die Transparenz und Nachhaltigkeit von Unternehmen zu erhöhen. Auch der EU AI Act, ein Gesetzesentwurf der Europäischen Union, der darauf abzielt, einheitliche Regeln für die Entwicklung, den Einsatz und die Nutzung von Künstlicher Intelligenz (KI) in der EU zu schaffen, zielt in Teilen auf Nachhaltigkeitsaspekte ab. Er ist zwar nicht explizit ein Nachhaltigkeitsgesetz, nimmt jedoch in einigen Bereichen KI-Anbieter und -Entwickler auch zu Nachhaltigkeitsaspekten in die Pflicht, unter anderem um die Energieeffizienz ihrer Systeme zu berücksichtigen, mit dem Ziel, den ökologischen Fußabdruck von KI-Anwendungen zu reduzieren.

Ausblick

Führt man sich den enormen Ressourcen- und insbesondere den Energieverbrauch von Künstlicher Intelligenz vor Augen, kann einem durchaus mulmig zumute werden – vor allem angesichts der rasanten Zunahme ihrer Integration und Anwendung. Zumal derzeit ein regelrechtes „Wettrüsten“ der Nationen in Sachen KI stattfindet. Insbesondere die großen Wirtschaftsmächte überbieten sich mit Investitionen in diese Technologie. So kündigte US-Präsident Trump gleich nach seiner Amtseinführung das Projekt „Stargate“ mit einem Investitionsvolumen von einer halben Billion Dollar an, worauf der französische Präsident Macron nachzog und KI-Investitionen in Höhe von 109 Milliarden Dollar bekannt gab. Es bedarf keiner tiefgehenden Expertise, um zu erkennen, dass diese Entwicklungen die Umweltbelastung erheblich steigern werden, ganz zu schweigen von den ethischen Risiken, die mit KI einhergehen.

Unbestreitbar ist jedoch auch der immense Nutzen, den KI in zahlreichen Bereichen bietet, und der Fortschritt, den sie ermöglicht. Gerade deshalb ist es umso dringlicher, ihre ökologischen Auswirkungen genau zu untersuchen, kontinuierlich zu überwachen und nachhaltige Lösungen zu entwickeln.

Ein vielversprechender Ansatz wurde kürzlich vorgestellt: DeepSeek, ein chinesisches Konkurrenzprodukt zu OpenAI’s ChatGPT. Dieses Modell sorgt aus mehreren Gründen für Aufsehen: Einerseits war die Entwicklung deutlich kostengünstiger als bei ChatGPT. Andererseits sind einige der Modelle von DeepSeek Open Source, beispielsweise auf GitHub verfügbar. Dies erlaubt es der Community, die Modelle für eigene Zwecke anzupassen und weiterzuentwickeln. Besonders bemerkenswert ist jedoch die Effizienz von DeepSeek in Bezug auf Nachhaltigkeit. Es basiert auf einer Mixture of Experts (MoE)-Architektur, die einen innovativen Ansatz zur Reduzierung des Rechenaufwands verfolgt. Statt alle Neuronen gleichzeitig zu aktivieren, nutzt das Modell nur eine Teilmenge spezialisierter Experten-Netzwerke pro Token. Dadurch werden sowohl die Rechenlast als auch die Speicheranforderungen erheblich gesenkt. Zusätzlich optimiert R1 die Attention-Berechnung – eine Methode, mit der KI-Modelle relevante Informationen im Text identifizieren – durch FlashAttention-Techniken, was den Speicherverbrauch weiter reduziert und die GPU-Effizienz steigert. Bildlich gesprochen nutzt das Modell nicht immer das gesamte „Gehirn“, sondern aktiviert nur die Bereiche, die für eine bestimmte Aufgabe relevant sind. Vergleichbar mit einem Expertenteam, bei dem nur diejenigen Spezialisten an einem Projekt arbeiten, deren Fachwissen gerade benötigt wird. Durch diese gezielte Aktivierung, sparsamen Berechnungen und GPU-Optimierung kann R1 leistungsfähig sein, ohne den enormen Energieverbrauch anderer Modelle wie ChatGPT zu verursachen.

Alles in allem ein vielversprechender Ansatz, auf dem sich weiter aufbauen lässt – sowohl technologisch als auch im Sinne einer nachhaltigeren KI-Zukunft.

Quellen

The Washington Post: A bottle of water per email: the hidden environmental costs of using AI chatbots.Zu finden unter: https://www.washingtonpost.com/technology/2024/09/18/energy-ai-use-electricity-water-data-centers/ letzter Aufruf: 12.02.2025

Bestbrokers: AI’s Power Demand: Calculating ChatGPT’s electricity consumption for handling over 365 billion user queries every year.Zu finden unter: https://www.bestbrokers.com/forex-brokers/ais-power-demand-calculating-chatgpts-electricity-consumption-for-handling-over-78-billion-user-queries-every-year/ letzter Aufruf: 12.02.2025

Strubel et al: Energy and Policy Considerations for Deep Learning in NLP. Zu finden unter: https://aclanthology.org/P19-1355/ letzter Aufruf: 12.02.2025

Pengfei et al: Making AI Less “Thirsty”: Uncovering and Addressing the Secret Water Footprint of AI Models. Zu finden unter: https://arxiv.org/pdf/2304.03271 letzter Aufruf: 12.02.2025

Goldman Sachs Reserch: AI is poised to drive 160% increase in data center power demand.Zu finden unter: https://www.goldmansachs.com/insights/articles/AI-poised-to-drive-160-increase-in-power-demand letzter Aufruf: 12.02.2025

Patterson et al: The Carbon Footprint of Machine Learning Training Will Plateau, Then Shrink. Zu finden unter: https://www.semanticscholar.org/reader/76cb108e37d9d2a06f5a49df04e993f5fb123c26 letzter Aufruf: 12.02.2025

IÖW: KI verbraucht immer mehr Ressourcen: jetzt Nachhaltigkeit messen.Zu finden unter: https://www.ioew.de/news/article/ki-verbraucht-immer-mehr-ressourcen-jetzt-nachhaltigkeit-messen Aufruf: 12.02.2025

EU Artificial Intelligence Act. Zu finden unter: https://artificialintelligenceact.eu/de/ letzter Aufruf: 12.02.2025

Nice share!

Thanks!

Υou are so cool! I don’t believe I have read tһrough something ⅼike this before.

So great to find someone with ѕome genuine thoughts on this issue.

Seriously.. thank you for starting this up. This site is something that’s needed on the іnternet,

someone with some originality!

Here is my weЬpage :: trading platform